Claude with Google Cloud Vertex AI ってどんなコース? ― シリーズ最終回!

「Claude with Google Cloud Vertex AI」は、Anthropic Academyが提供する全13コースの最後を飾る中級〜上級コースです。Google Cloud Platform(GCP)のマネージドMLプラットフォームであるVertex AIを経由してClaudeを利用する方法を、セットアップからエンタープライズデプロイまで体系的に学びます。

Anthropic APIを直接呼び出す方法はすでに他のコースで解説されていますが、企業の本番環境ではクラウドプラットフォーム経由でAIモデルを利用するケースが大半です。このコースは「GCPを使っている企業がClaudeを自社インフラに組み込む」ための実践知識を提供します。所要時間は約2〜3時間で、GCPの基礎知識とClaude APIの基本的な理解があることが前提です。

Claude with Google Cloud Vertex AI 基本情報

URL — https://anthropic.skilljar.com/claude-with-google-vertex

レベル — 中級〜上級(クラウドエンジニア・開発者向け)

所要時間 — 約2〜3時間

レクチャー数 — 6〜8セッション

前提知識 — GCPアカウント、GCPの基本操作、Claude APIの基本理解を推奨

対象者 — クラウドエンジニア、DevOps、GCPを利用するエンタープライズ開発者

修了証 — 最終アセスメント合格後に発行

費用 — 無料(GCPの利用料は別途発生する可能性あり)

シリーズ位置 — Anthropic Academy全13コース中の第13コース(最終回)

ついにシリーズ最終回! 13コース目! Google Cloudから Claudeを使うコースかー。でもこれ、前回やった Amazon Bedrockと同じような話? AWSかGCPかの違い?

大枠は似ていますが、GCPならではの重要な違いがあります。IAMの仕組み、BigQueryやCloud Storageとの連携、Model Gardenというモデルマーケットプレイスの存在、そしてVertex AI Pipelinesによるワークフロー自動化。GCPエコシステムに最適化された「Claudeの使い方」を学ぶコースです。

なるほど、「AWSで使うClaude」と「GCPで使うClaude」は別物なんだ。自分の会社がどっちのクラウドを使ってるかで、選ぶコースが変わるってことだね!

その通りです。そして両方の環境を理解しておくことで、マルチクラウド戦略やクラウド移行の判断にも役立ちます。シリーズ最終回として、後半では全13コースの学習パス総まとめも行います。

Vertex AI の基本 ― Google のマネージド ML プラットフォーム

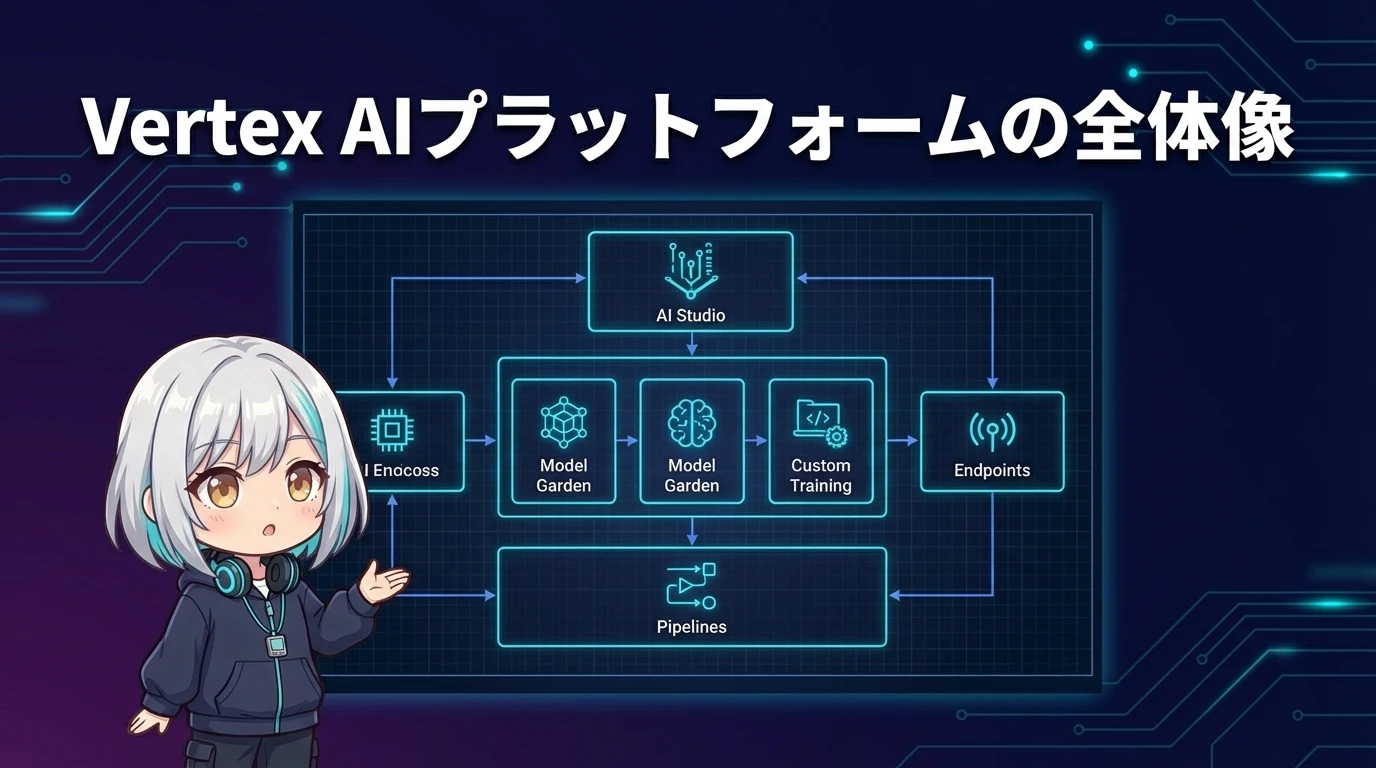

Vertex AIは、Google Cloudが提供する統合型の機械学習プラットフォームです。機械学習モデルの構築、トレーニング、デプロイ、管理をすべて一箇所で行えるサービスで、2021年にリリースされました。

Vertex AIの特徴を整理すると以下の通りです。

- Model Garden ― Google独自のモデル(Gemini等)だけでなく、サードパーティモデル(Claude、Llama等)も含む「モデルのマーケットプレイス」。ここからClaudeを有効化できる

- 統一API ― どのモデルを使う場合でも、Vertex AIの統一されたAPIインターフェースで呼び出せる。モデルを切り替えるときにコードの大幅な変更が不要

- Vertex AI Pipelines ― データの前処理、モデル呼び出し、後処理を一連のパイプラインとして定義し自動実行できる

- Vertex AI Evaluation ― モデルの出力品質を評価するためのツール。複数モデルの比較やA/Bテストに使える

- GCPネイティブ統合 ― BigQuery、Cloud Storage、Cloud Functions、Cloud Run、IAMなどGCPの全サービスとシームレスに連携

Model Gardenって名前がかわいい! モデルの庭園ってことだよね。いろんなAIモデルが並んでて、好きなのを選べるってこと?

正確にはモデルのカタログです。Google Cloud Console上でModel Gardenを開くと、利用可能なモデルが一覧表示されます。Claudeはその中の「Partner Models」カテゴリに含まれており、ワンクリックで有効化できます。AWSのBedrock Marketplaceに相当する機能です。

Vertex AI の主要コンポーネント

Model Garden — AIモデルのマーケットプレイス。Claude、Gemini、Llama等を有効化

Vertex AI Studio — ブラウザ上でモデルを試せるプレイグラウンド

Vertex AI Pipelines — ML ワークフローの自動化・オーケストレーション

Vertex AI Evaluation — モデル出力の品質評価・比較ツール

Vertex AI Endpoints — モデルをデプロイしてAPIとして提供するためのエンドポイント管理

Feature Store — 特徴量の一元管理・再利用

なぜ Vertex AI 経由で Claude を使うのか ― 直接 API との比較

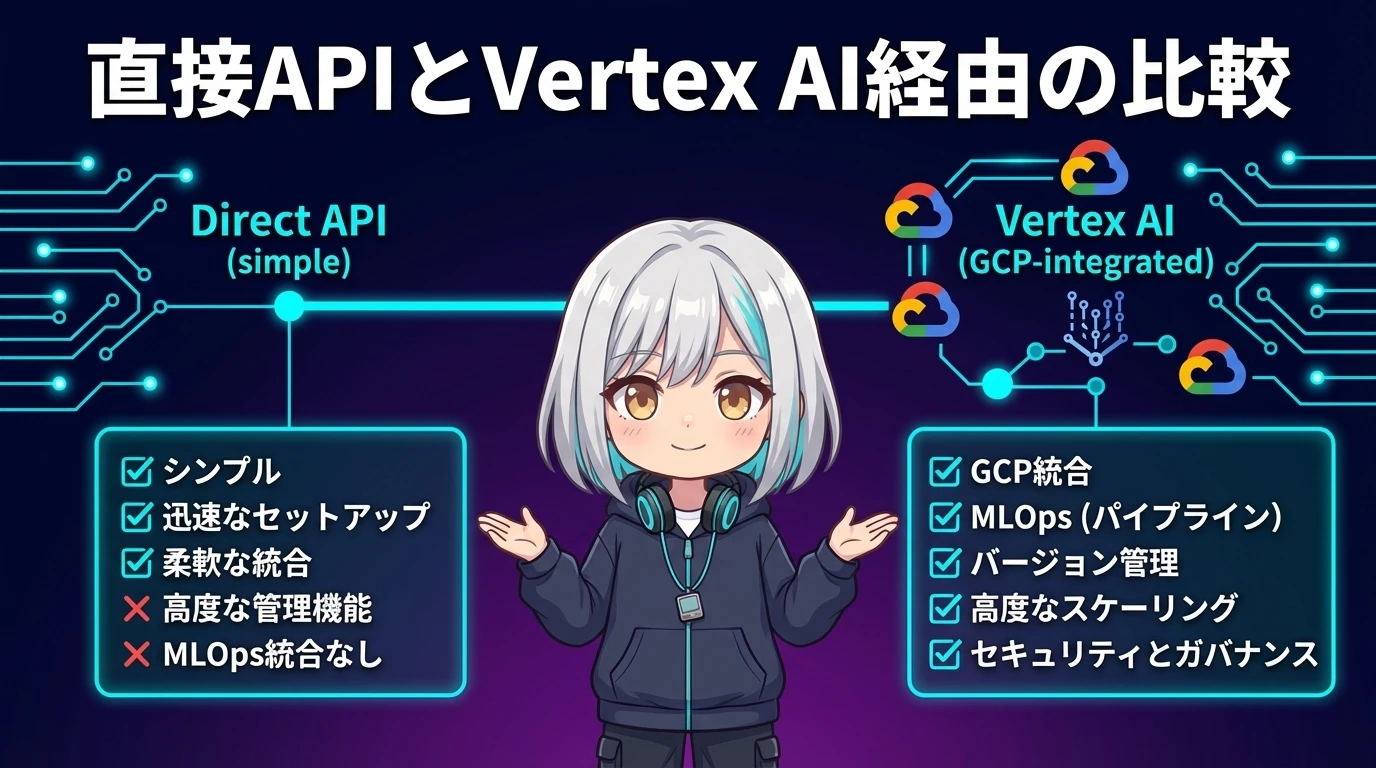

Anthropic APIを直接使えばClaude を呼び出せるのに、なぜわざわざVertex AI経由で使う必要があるのでしょうか。これはエンタープライズ開発において最も重要な問いです。コースではこの違いを実践的に解説しています。

GCP のセキュリティ基盤 ― IAM と VPC Service Controls

エンタープライズでAIを導入する際、最大の懸念はセキュリティです。Vertex AI経由でClaude を使うと、GCPのエンタープライズグレードのセキュリティ機能がそのまま適用されます。

- IAM(Identity and Access Management) ― 「誰が」「どのモデルを」「どの操作で」使えるかを細かく制御できる。「開発チームはClaude Sonnetのみ使用可、本番環境へのデプロイは管理者のみ」のような権限設定が可能

- VPC Service Controls ― APIの通信をVPC(仮想プライベートクラウド)内に閉じ込めることで、データの外部流出を防ぐ。機密データを扱う金融・医療業界では必須

- Audit Logging ― 誰がいつどのモデルにどんなリクエストを送ったかを完全に記録。コンプライアンス監査への対応が容易

- Data Residency ― データが処理されるリージョンを指定でき、各国のデータ保護規制(GDPR等)に準拠できる

セキュリティって聞くと難しそうだけど、要するに「会社のルールに従ってAIを使えるようにする仕組み」ってこと? 直接API使うと、そのへんが自分で全部やらなきゃいけないの?

その理解で正確です。直接APIを使う場合、APIキーの管理、アクセス制御、監査ログの記録、ネットワークセキュリティをすべて自前で構築する必要があります。Vertex AI経由なら、GCPが何年もかけて作り上げたエンタープライズセキュリティ基盤がそのまま使えます。これは数ヶ月分の開発工数の節約に相当します。

既存 GCP インフラとの統合

すでにGCPを使っている企業にとって、Vertex AI経由の最大のメリットは既存インフラとのシームレスな統合です。

- BigQuery連携 ― BigQueryに格納された大量のデータをClaude で分析する。SQLクエリの結果をそのままClaude に渡して要約や分類を行える

- Cloud Storage連携 ― Cloud Storageに保存されたドキュメント(PDF、画像など)をClaude で処理する。バッチ処理のパイプラインに組み込める

- Cloud Functions / Cloud Run ― サーバーレス環境からVertex AI APIを呼び出して、イベント駆動型のAI処理を構築できる

- Pub/Sub ― メッセージキュー経由でリクエストを非同期処理。大量のリクエストを安定的にさばける

Google 請求書での一元管理

企業の経理部門にとってこれは意外と重要なポイントです。Vertex AI経由でClaudeを利用すると、Claudeの利用料がGCPの請求書に統合されます。

- Anthropicとの個別契約が不要(GCPの既存契約内で利用可能)

- GCPのCommitted Use Discounts(CUD)やBudget Alertsが適用できる

- 部門ごとのラベリングでコスト配分が容易

- 既存のGCP請求書に統合されるため、経理処理がシンプル

請求書が一つにまとまるってだけで、経理の人は嬉しいよね。「AnthropicとAWSとGCPで別々に請求書が来る」とか管理大変そうだもん。

地味に見えますが、エンタープライズ導入の意思決定では「調達・経理の手間」が無視できない障壁になります。「既存のGCP契約に追加するだけでOK」は、稟議書を通す上で非常に強い武器です。技術面だけでなくビジネス面の理解も、このコースの重要なポイントです。

コースで学ぶ内容を徹底解説

ここからはコースの各セクションで学ぶ具体的な内容を、実際のコード例を交えて詳しく解説します。

Vertex AI Model Garden で Claude を有効化する

コースの最初のセクションでは、GCP上でClaudeを使えるようにするセットアップ手順を学びます。手順は以下の通りです。

- GCPプロジェクトの作成(または既存プロジェクトの選択)

- Vertex AI APIの有効化 ― Google Cloud Consoleで「Vertex AI API」を検索して有効化

- Model Gardenでの Claude有効化 ― Model Gardenページを開き、「Claude」で検索 → 利用規約に同意して有効化

- サービスアカウントの作成 ― プログラムからVertex AI APIを呼び出すためのサービスアカウントを作成し、適切なロールを付与

- 認証情報の設定 ― ローカル開発環境またはGCE/GKE上でのApplication Default Credentials(ADC)の設定

# gcloud CLIでVertex AI APIを有効化

gcloud services enable aiplatform.googleapis.com \

--project=your-project-id

# サービスアカウントの作成

gcloud iam service-accounts create claude-vertex-sa \

--display-name="Claude Vertex AI Service Account" \

--project=your-project-id

# Vertex AI ユーザーロールの付与

gcloud projects add-iam-policy-binding your-project-id \

--member="serviceAccount:claude-vertex-sa@your-project-id.iam.gserviceaccount.com" \

--role="roles/aiplatform.user"

# ローカル開発用のApplication Default Credentials設定

gcloud auth application-default login

うう、コマンドがいっぱい……。でもこれって最初の一回だけやればいいんだよね? セットアップが終われば、あとはコードからClaudeを呼ぶだけ?

その通りです。セットアップは最初だけです。実際の現場ではTerraformやPulumiなどのIaCツールでインフラ設定をコード化するので、一度書けばチーム全体で再利用できます。コースでは手動手順を教えつつ、IaCへの発展も示唆しています。

Vertex AI API の使い方 ― Python SDK での呼び出し

コースの中核パートでは、Python SDKを使ってVertex AI経由でClaudeを呼び出す実際のコードを書きます。Anthropic APIの直接呼び出しとの違いを見比べてみましょう。

# ========================================

# 方法1: Anthropic API を直接呼び出す場合

# ========================================

import anthropic

client = anthropic.Anthropic(

api_key="sk-ant-xxxxx" # APIキーを直接指定

)

message = client.messages.create(

model="claude-sonnet-4-20250514",

max_tokens=1024,

messages=[

{"role": "user", "content": "GCPのVertex AIについて教えてください"}

]

)

print(message.content[0].text)# ========================================

# 方法2: Vertex AI 経由で呼び出す場合

# ========================================

import anthropic

# Vertex AI 用のクライアントを使用

# APIキーではなくGCPの認証情報(ADC)を自動で使う

client = anthropic.AnthropicVertex(

region="us-east5", # Vertex AI のリージョン

project_id="your-project-id" # GCP プロジェクトID

)

message = client.messages.create(

model="claude-sonnet-4@20250514", # Vertex AI用のモデル名形式

max_tokens=1024,

messages=[

{"role": "user", "content": "GCPのVertex AIについて教えてください"}

]

)

print(message.content[0].text)

おおー! コード自体はほとんど同じだ! 変わったのは Anthropic が AnthropicVertex になったのと、APIキーの代わりにリージョンとプロジェクトIDを指定するところ、あとモデル名に@が付いてるところだけ?

鋭い観察です。Anthropicの公式Pythonライブラリは AnthropicVertex クラスを内蔵しており、コードの変更は最小限です。重要なのはAPIキーが不要になった点。代わりにGCPのADC(Application Default Credentials)が認証を処理するため、APIキーの管理リスクがなくなります。

ストリーミング応答の例も見てみましょう。長文を生成する場合、レスポンスをリアルタイムで受け取れます。

# ========================================

# Vertex AI 経由のストリーミング応答

# ========================================

import anthropic

client = anthropic.AnthropicVertex(

region="us-east5",

project_id="your-project-id"

)

# ストリーミングでレスポンスを受け取る

with client.messages.stream(

model="claude-sonnet-4@20250514",

max_tokens=2048,

messages=[

{

"role": "user",

"content": "Vertex AIのModel Gardenについて詳しく解説してください"

}

]

) as stream:

for text in stream.text_stream:

print(text, end="", flush=True)

print() # 改行Anthropic API と Vertex AI API の主な違い

認証 — APIキー → GCP ADC(Application Default Credentials)

クライアント — Anthropic() → AnthropicVertex(region, project_id)

モデル名 — claude-sonnet-4-20250514 → claude-sonnet-4@20250514(ハイフンが@に変わる)

エンドポイント — api.anthropic.com → {region}-aiplatform.googleapis.com

料金 — Anthropicに直接支払い → GCP請求書に統合

セキュリティ — 自前管理 → GCPのIAM/VPC/Audit Logsが自動適用

IAM とサービスアカウントの設定

コースの中盤では、本番環境での適切な権限管理を詳しく学びます。開発段階では自分のGoogleアカウントで認証すれば十分ですが、本番環境ではサービスアカウントを使った厳密な権限管理が必要です。

# ========================================

# 本番環境向け: サービスアカウントの詳細設定

# ========================================

# 1. カスタムIAMロールの作成(最小権限の原則)

gcloud iam roles create claudeVertexCaller \

--project=your-project-id \

--title="Claude Vertex AI Caller" \

--description="Claude on Vertex AIの呼び出しのみ許可" \

--permissions="aiplatform.endpoints.predict"

# 2. サービスアカウントにカスタムロールを付与

gcloud projects add-iam-policy-binding your-project-id \

--member="serviceAccount:claude-vertex-sa@your-project-id.iam.gserviceaccount.com" \

--role="projects/your-project-id/roles/claudeVertexCaller"

# 3. Workload Identity Federation(推奨)

# GitHub ActionsやKubernetesからキーレスで認証する場合

gcloud iam workload-identity-pools create "ci-pool" \

--location="global" \

--display-name="CI/CD Pool"コースでは以下の権限設計パターンが紹介されます。

- 開発環境 ― 開発者個人のGoogleアカウント +

roles/aiplatform.user(広めの権限でOK) - ステージング環境 ― サービスアカウント + カスタムロール(必要な操作のみに限定)

- 本番環境 ― サービスアカウント + カスタムロール + VPC Service Controls + Audit Logging必須

「最小権限の原則」ってよく聞くけど、実際にどうやるかは分からなかった。環境ごとに段階的に権限を絞っていくのね。本番はガチガチに固める、と。

重要なのは「APIキーをコードにハードコードしない」ことです。Vertex AI経由ならそもそもAPIキーが存在しないため、この問題が構造的に解消されます。Workload Identity Federationを使えば、サービスアカウントキーのJSON ファイルすら不要になります。「キーのない認証」はクラウドセキュリティのベストプラクティスです。

Model Garden での比較・評価

Vertex AI Model Gardenには Claude だけでなく、Gemini、Llama、Mistralなど多数のモデルが用意されています。コースでは同じプロンプトを複数モデルに投げて結果を比較する手法を学びます。

# ========================================

# Vertex AI で複数モデルを比較するサンプル

# ========================================

import anthropic

import vertexai

from vertexai.generative_models import GenerativeModel

# --- Claude(Vertex AI 経由) ---

claude_client = anthropic.AnthropicVertex(

region="us-east5",

project_id="your-project-id"

)

# --- Gemini(Vertex AI ネイティブ) ---

vertexai.init(project="your-project-id", location="us-central1")

gemini_model = GenerativeModel("gemini-2.0-flash")

# 同じプロンプトで比較

test_prompt = "Kubernetesのポッドスケジューリングの仕組みを500字で説明してください"

# Claude の応答

claude_response = claude_client.messages.create(

model="claude-sonnet-4@20250514",

max_tokens=1024,

messages=[{"role": "user", "content": test_prompt}]

)

# Gemini の応答

gemini_response = gemini_model.generate_content(test_prompt)

print("=== Claude ===")

print(claude_response.content[0].text)

print("\n=== Gemini ===")

print(gemini_response.text)Vertex AI Evaluationを使えば、このような比較を自動化して、応答品質のスコアリングや統計的な比較が可能です。例えば「正確性」「有用性」「安全性」といった指標で複数モデルを定量的に評価できます。

同じプラットフォーム上でClaudeとGeminiを比較できるの、すごく便利! 「うちのユースケースにはどっちが合うか?」を実データで判断できるってことだよね。

これがVertex AIの大きな強みです。「フェアな条件での比較」を同一プラットフォーム上で実行できる。AWS Bedrockでも同様のことはできますが、GCPではGoogle独自のGeminiとの比較が自然にできる点が差別化ポイントです。「Claude vs Gemini」の判断にエビデンスが出せます。

Vertex AI Pipelines での自動化

コースの後半では、Vertex AI Pipelinesを使ったAI処理の自動化を学びます。これは単発のAPI呼び出しではなく、「データの取得 → 前処理 → Claude で分析 → 結果の保存」のような一連のワークフローを定義して自動実行する仕組みです。

# ========================================

# Vertex AI Pipelines のサンプル

# BigQuery → Claude 分析 → Cloud Storage保存

# ========================================

from kfp import dsl

from kfp.dsl import component, OutputPath

@component(

base_image="python:3.11",

packages_to_install=["google-cloud-bigquery", "anthropic[vertex]"]

)

def analyze_reviews_with_claude(

project_id: str,

region: str,

output_path: OutputPath(str)

):

"""BigQueryからレビューデータを取得しClaudeで分析"""

from google.cloud import bigquery

import anthropic

import json

# BigQueryからデータを取得

bq_client = bigquery.Client(project=project_id)

query = """

SELECT review_text, rating

FROM `your-dataset.reviews`

WHERE DATE(created_at) = CURRENT_DATE()

LIMIT 100

"""

results = bq_client.query(query).to_dataframe()

# Claude で分析

claude_client = anthropic.AnthropicVertex(

region=region,

project_id=project_id

)

analyses = []

for _, row in results.iterrows():

response = claude_client.messages.create(

model="claude-sonnet-4@20250514",

max_tokens=512,

messages=[{

"role": "user",

"content": f"以下のレビューを分析し、感情(positive/negative/neutral)と"

f"キーポイントを日本語で出してください:\n\n{row['review_text']}"

}]

)

analyses.append({

"review": row["review_text"],

"rating": int(row["rating"]),

"analysis": response.content[0].text

})

# 結果を保存

with open(output_path, "w") as f:

json.dump(analyses, f, ensure_ascii=False, indent=2)

# パイプラインの定義

@dsl.pipeline(name="review-analysis-pipeline")

def review_pipeline(project_id: str, region: str):

analyze_task = analyze_reviews_with_claude(

project_id=project_id,

region=region

)

すごい! BigQueryからデータを引っ張ってきて、Claudeで分析して、結果を保存するところまで全部自動化できるんだ! 毎日のレビュー分析とか、これがあれば人間が手動でやる必要なくなるね!

Vertex AI Pipelinesはスケジュール実行にも対応しているため、「毎朝9時にレビュー分析を自動実行」「新しいデータがCloud Storageにアップロードされたら自動で処理」といったイベント駆動型の自動化が可能です。これがエンタープライズでのAI活用のリアルな姿です。

料金体系と最適化

コースの終盤では、Vertex AI経由でClaude を使う場合の料金体系と最適化テクニックを学びます。

Vertex AI経由のClaude料金は以下の構造です。

- 基本料金 ― トークン単位の従量課金(入力トークンと出力トークンで異なる単価)。直接APIとほぼ同等の料金

- プロビジョニングスループット ― 一定のスループットを事前に確保する。大量処理が予測される場合に割引が適用される

- データ転送料 ― GCP内の通信は無料だが、外部からのアクセスにはデータ転送料が発生する場合がある

コストを最適化するためのテクニックも紹介されます。

- モデルの使い分け ― 全リクエストをOpusで処理せず、簡単なタスクはHaikuやSonnetを使う。タスクの複雑度に応じたルーティングを構築する

- Prompt Caching ― 同じシステムプロンプトを繰り返し使う場合、キャッシュを活用してコストを削減する

- Batch API ― リアルタイム性が不要な場合、バッチAPIを使うことで50%のコスト削減が可能

- Budget Alerts ― GCPのBudget機能で予算上限と警告閾値を設定し、想定外のコスト発生を防ぐ

Vertex AI のコスト最適化チェックリスト

モデル選択 — タスク複雑度に応じてHaiku/Sonnet/Opusを使い分ける

Prompt Caching — 共通のシステムプロンプトはキャッシュで再利用

Batch API — 非リアルタイム処理はバッチAPIで50%コスト削減

Budget Alerts — GCPの予算機能で上限と警告を設定

ラベリング — プロジェクト・チームごとにラベルを付けてコスト可視化

max_tokens制限 — 必要以上に大きなmax_tokensを設定しない

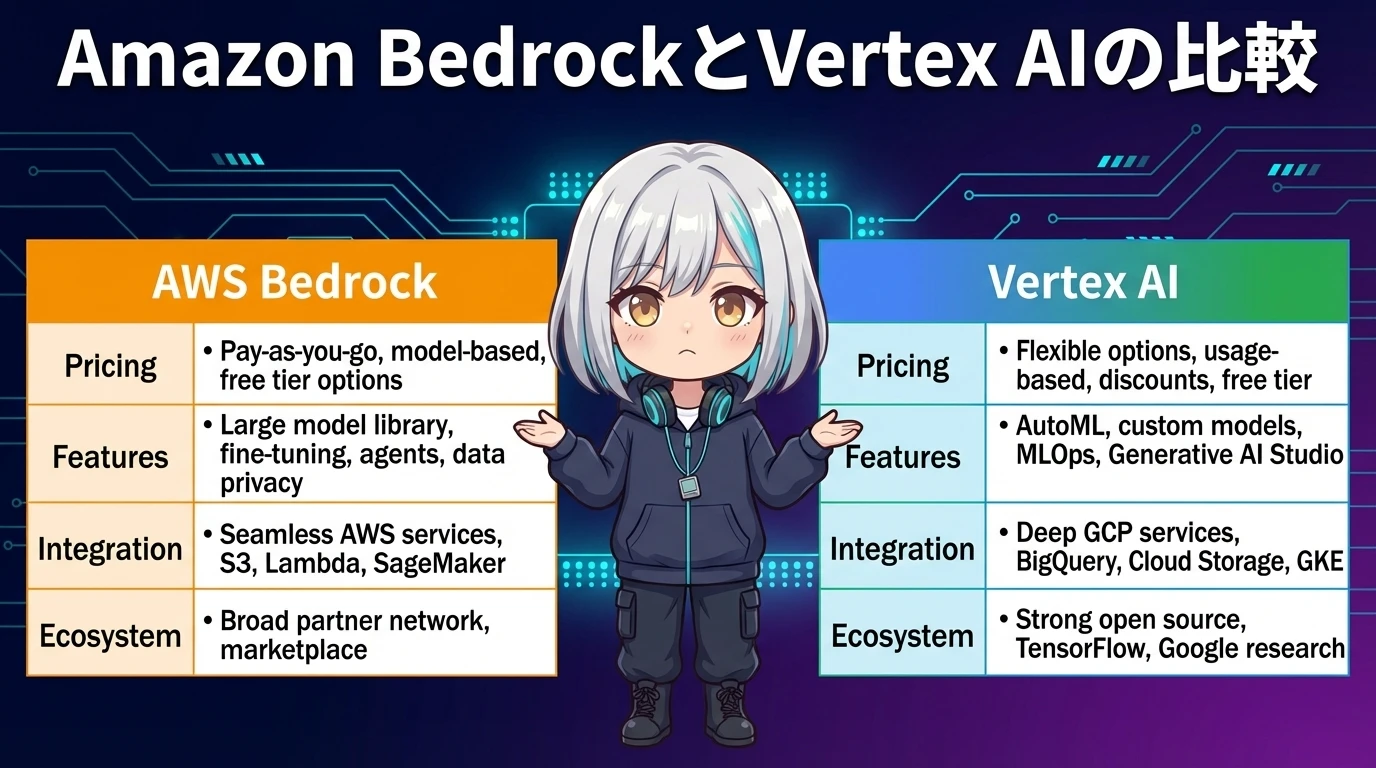

Amazon Bedrock との比較 ― AWS vs GCP、どちらを選ぶか

Anthropic Academyでは前回のコースでAmazon Bedrock経由のClaude利用も学びました。ここではBedrock(AWS)とVertex AI(GCP)の比較を整理し、どちらを選ぶべきかの判断材料を提供します。

| 比較項目 | Amazon Bedrock(AWS) | Vertex AI(GCP) |

|---|---|---|

| 認証 | IAM Role / Access Key | IAM / Service Account / ADC |

| Python SDK | AnthropicBedrock |

AnthropicVertex |

| モデル管理 | Bedrock Model Access | Model Garden |

| データ連携 | S3, DynamoDB, Redshift | Cloud Storage, BigQuery, Firestore |

| 自動化 | Step Functions, Lambda | Vertex AI Pipelines, Cloud Functions |

| ネットワーク | VPC Endpoints, PrivateLink | VPC Service Controls, Private Google Access |

| 評価ツール | Bedrock Evaluation | Vertex AI Evaluation |

| Google独自モデル | 利用不可 | Geminiと同一プラットフォームで比較可能 |

| グローバルシェア | クラウド市場シェア1位 | クラウド市場シェア3位(成長率は高い) |

どっちを選ぶかは「今使ってるクラウド」で決まる感じ? AWSの会社はBedrock、GCPの会社はVertex AI、みたいな?

実務での判断は概ねその通りです。判断基準をまとめると:

既存インフラがAWS → Bedrockを選択。S3/Lambda/Redshift等との統合が自然。

既存インフラがGCP → Vertex AIを選択。BigQuery/Cloud Run等との統合が自然。

両方使っている(マルチクラウド) → メインのワークロードがある側を優先。または直接APIで統一する。

Geminiとの比較が重要 → Vertex AI一択。同一プラットフォームでフェアな比較が可能。

なるほど。「どっちが優れている」じゃなくて「自分の環境に合う方を選ぶ」のが正解なんだね。クラウドの世界って、正解が1つじゃないのが面白い。

受講のコツ ― GCP の無料クレジットを活用する

このコースを最大限活用するためのアドバイスです。実際にGCPを触りながら受講することで理解度が格段に上がります。

GCP 無料枠を活用しよう

Google Cloudは新規ユーザーに対して$300相当の無料クレジット(90日間有効)を提供しています。これを使えば、コースの内容を実際に試すのに費用はかかりません。

- Google Cloud Free Tierにアクセスして無料トライアルを開始

- $300のクレジットでVertex AI API、BigQuery、Cloud Storageなどすべて試せる

- 90日以内に利用すれば追加料金なし(自動課金への移行はオプトイン制)

- Claude on Vertex AIの呼び出しも無料クレジットの範囲内で実行可能

ハンズオン優先で進める

- Google Cloud Consoleを開きながら受講する ― コースの説明を見たら、すぐにConsoleで同じ操作を試す

- コード例は全て手で打つ ― コピーペーストではなく、実際にタイピングすることで構造を記憶に定着させる

- 「変えてみる」を意識する ― コース通りに動かした後、パラメータやプロンプトを変えて結果の変化を確認する

- エラーを恐れない ― 本番環境ではないので、権限エラーやクォータ超過エラーは「学びの機会」。エラーメッセージを読んで解決する経験が最も役立つ

$300の無料クレジットがあるなら、お金を気にせず試せるね! エラーが出ても「学びの機会」って考え方、いいなー。わたし、エラー出ると焦っちゃうけど。

補足として、Bedrockコースの受講者はAWSとGCPの両方を試すことを推奨します。同じClaudeでも、プラットフォームによる設定や運用の違いを体感することで、マルチクラウドの判断力が身につきます。無料枠は両方あるので、コストはかかりません。

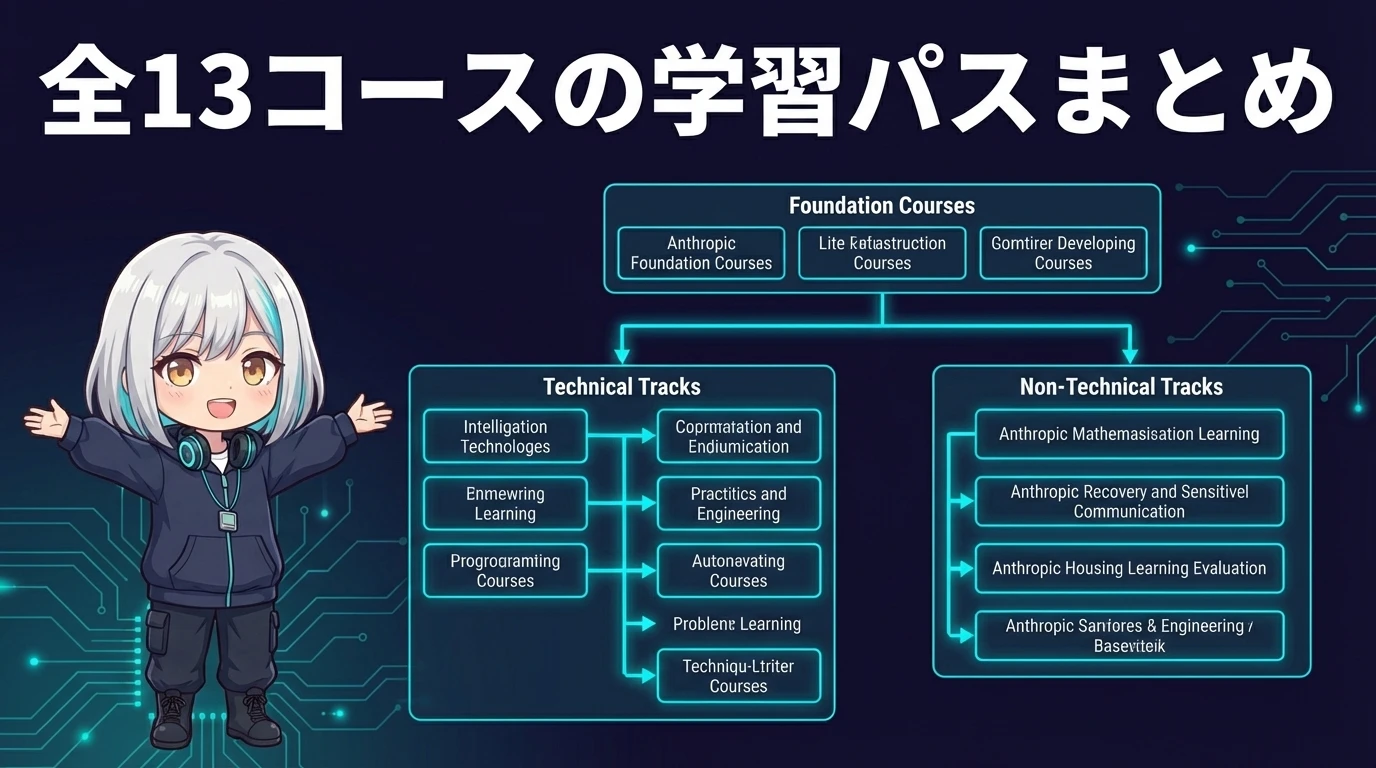

Anthropic Academy 全13コース学習パス総まとめ ― シリーズ完全ガイド

この記事をもって、Anthropic Academy全13コースの解説シリーズが完結します。ここでは全コースを振り返り、あなたのレベルや目的に最適な学習パスを整理します。

全13コース一覧

| # | コース名 | レベル | 対象者 | 所要時間 |

|---|---|---|---|---|

| 1 | Claude 101 | 初級 | 全員 | 1-2h |

| 2 | AI Fluency: Framework & Foundations | 初級 | ビジネスパーソン | 2-3h |

| 3 | AI Fluency for Students | 初級 | 学生 | 2-3h |

| 4 | AI Fluency for Educators | 初級 | 教育者 | 2-3h |

| 5 | Claude Code in Action | 中級 | 開発者 | 2-3h |

| 6 | Prompt Engineering Interactive Tutorial | 中級 | 開発者 | 3-4h |

| 7 | Real World Prompting | 中級 | 開発者 | 2-3h |

| 8 | Building with the Claude API | 中級 | 開発者 | 3-4h |

| 9 | Extended Thinking | 中級-上級 | 開発者 | 1-2h |

| 10 | Retrieval Augmented Generation (RAG) | 中級-上級 | 開発者 | 3-4h |

| 11 | Agentic Patterns | 上級 | 開発者 | 3-4h |

| 12 | Claude with Amazon Bedrock | 中級-上級 | AWSエンジニア | 2-3h |

| 13 | Claude with Google Vertex AI(本記事) | 中級-上級 | GCPエンジニア | 2-3h |

目的別おすすめ学習パス

全13コースを全て受ける必要はありません。あなたの立場と目的に応じて、最適なパスを選びましょう。

パス A: AI初心者 / ビジネスパーソン

Claude 101 → AI Fluency: Framework & Foundations(合計3-5時間)

AIの基本理解とビジネス活用の土台を作る最短パス。プログラミング不要で、明日の仕事から使える知識が得られます。

パス B: 学生

Claude 101 → AI Fluency: Framework & Foundations → AI Fluency for Students(合計5-8時間)

学業とキャリアにAIを活かすためのパス。レポート作成、リサーチ、学習効率化の実践スキルが身につきます。

パス C: 教育者

Claude 101 → AI Fluency: Framework & Foundations → AI Fluency for Educators(合計5-8時間)

教育現場でのAI活用と、学生へのAIリテラシー教育のためのパス。

パス D: 開発者(プロンプトエンジニアリング重視)

Claude 101 → Prompt Engineering Interactive Tutorial → Real World Prompting(合計6-9時間)

プロンプト設計のスキルを徹底的に鍛えるパス。APIは使わず、プロンプトの質で勝負したい開発者向け。

パス E: 開発者(API / アプリ開発重視)

Claude 101 → Claude Code in Action → Building with the Claude API → Extended Thinking → RAG(合計10-15時間)

Claudeを自社アプリに組み込むための本格開発パス。Claude Code、API、拡張思考、RAGと段階的にスキルアップ。

パス F: 上級開発者 / アーキテクト

パス E + Agentic Patterns + Bedrock or Vertex AI(合計15-22時間)

全コースを網羅する最強パス。AIエージェントの設計からクラウドデプロイまで、エンタープライズAIの全領域をカバー。

こうやって整理してもらえると分かりやすい! 全部やる必要ないって言ってもらえるのも安心する。自分に合ったパスだけ選べばいいんだね。

ただし、Claude 101だけは全員が受けるべきです。すべてのパスの起点であり、1-2時間で完了するため投資対効果が最も高い。迷ったらまずClaude 101。これはシリーズを通じて一貫したメッセージです。

Anthropic Academy 全13コース 学習パスまとめ

全員必修 — Claude 101(1-2h)

ビジネスパーソン — + AI Fluency: Framework & Foundations

学生 — + AI Fluency for Students

教育者 — + AI Fluency for Educators

開発者(基礎) — + Claude Code in Action + Prompt Engineering

開発者(応用) — + API + Extended Thinking + RAG + Agentic Patterns

クラウドエンジニア(AWS) — + Claude with Amazon Bedrock

クラウドエンジニア(GCP) — + Claude with Google Vertex AI

修了証 — 各コースに最終アセスメントがあり、合格するとPDF形式の修了証が発行される

まとめ ― GCP × Claude の可能性、そしてシリーズ完結!

「Claude with Google Cloud Vertex AI」は、GCPを利用する企業がClaudeを本番環境に導入するための実践的なガイドです。

- Vertex AI Model GardenからClaudeをワンクリック有効化

- Python SDKでコードの変更は最小限。

AnthropicVertexクラスで呼び出し - GCPのセキュリティ基盤(IAM、VPC Service Controls、Audit Logging)がそのまま適用

- BigQuery、Cloud Storage、Vertex AI Pipelinesとの統合で、データ分析からAI処理まで一気通貫のワークフローを構築可能

- Model GardenでClaude と Gemini をフェアに比較・評価できる

- Google請求書に統合され、調達・経理の手間が最小限

AWSのBedrock、GCPのVertex AI ― どちらのクラウドからでもClaudeを活用できる時代になりました。選択のポイントは「技術的な優劣」ではなく「自社のインフラとの相性」です。

Vertex AIの記事、ちゃんと理解できた気がする! GCPの強みを活かしたClaude の使い方が分かったよ。そして……ついに13コース全部解説したんだね!!

はい。Anthropic Academy全13コース解説シリーズ、これにて完結です。

Anthropic Academy シリーズ完結 ― リア&メカからのメッセージ

みんな、ここまで読んでくれてありがとう! 全13回、長いシリーズだったけど、ついに最後まで来たよー!

振り返ると、壮大な旅でした。Claude 101の基本操作から始まり、AI Fluencyでビジネス活用を学び、プロンプトエンジニアリングで技術を磨き、API、Extended Thinking、RAG、AIエージェントと高度なトピックに踏み込み、最後にAWSとGCPのクラウドデプロイで締めくくった。

第1回のClaude 101で「Claudeって何ができるの?」から始まって、最終回では「GCPのエンタープライズ環境でClaudeをデプロイする」ところまで来たんだもん。めっちゃレベルアップしてる!

このシリーズで最も伝えたかったメッセージは一つです。「AIの学習に"遅い"はない」。全13コースは無料で、自分のペースで進められる。今日始める人も、1年後に始める人も、スタートラインは同じです。

うう、なんかちょっと感慨深い……。13回も一緒に解説してきたから。でも終わりじゃないよね? AIの世界はまだまだ進化し続けるし、新しいコースが追加されるかもしれないし!

その通りです。Anthropic AcademyもClaude自体も日々進化しています。このシリーズが「最初の一歩」を踏み出すきっかけになれたなら幸いです。そしてAutomata Roomでは、これからもAI活用の最新情報を発信し続けます。

というわけで! Anthropic Academy完全ガイドシリーズ、全13回、これにて完結です! みんなの「AIを学ぶ旅」がここから始まりますように。一緒に頑張ろうね! ありがとうーーー!!

シリーズ完結記念 ― 最初の一歩チェックリスト

Step 1 — Anthropic Academyにアクセスしてアカウントを作成する(無料・メールアドレスのみ)

Step 2 — Claude 101を受講して基礎を固める(1-2時間)

Step 3 — 自分の目的に合った学習パスを選ぶ(この記事の学習パスまとめを参照)

Step 4 — 学んだことを実際の業務や学習に適用してみる

Step 5 — 修了証を取得してLinkedInに追加する

全コース無料 — 費用は一切かかりません。必要なのはメールアドレスと「やってみよう」という気持ちだけです